Un team del Sidi (Swiss Institute for Disruptive Innovation) è riuscito a dimostrare come oggi sia possibile impiegare l’intelligenza artificiale (AI) per comporre, arrangiare ed eseguire un brano musicale inedito, partendo da zero e inviando un solo input al sistema (il genere desiderato del brano). Non si tratta solo di un esercizio di tecnica informatica, quello a cui sta lavorando potrebbe essere l’inizio di un nuovo approccio allo show business musicale.

Nella pratica, il SIDI ha simulato la connessione di diversi moduli open source e proprietari con funzioni specifiche, creando un sistema “chiuso” in grado di generare autonomamente un brano. A questo processo ha applicato un sistema di deep learning (apprendimento profondo) che, attraverso cicli di rinforzo, riesce a migliorare costantemente il risultato in funzione del feedback dell’ascoltatore.

Abbiamo intervistato Pietro Veragouth, ideatore e coordinatore del progetto.

Qual è lo scopo di tutto questo?

«In realtà si tratta del primo passo, comunque necessario, per lo sviluppo di un sistema completamente autonomo capace di comporre ed eseguire musica iper-personalizzata in grado di piacere, nel vero senso della parola, a chiunque».

Una “macchina” che sa fare questo, ma è possibile?

«Nella prima fase abbiamo messo insieme i pezzi necessari per fare in modo che il sistema crei dal nulla una canzone e ne migliori il risultato. Si tratta di un processo circolare che ha però un limite intrinseco: il fatto che un brano non può essere oggettivamente e universalmente bello. Al sistema possono quindi essere forniti parametri generali all’interno di ranges piuttosto ampi. Componendo musica per hobby, mi rendo conto di quanto una piccola variazione possa incidere sul risultato. A ciò vanno aggiunte tutta una serie di considerazioni che vanno oltre la capacità di generare una sequenza di suoni armoniosi, e che sono di ordine psicologico e culturale ma anche legati a fattori quali l’esperienza musicale pregressa e i diversi condizionamenti che predispongono l’ascoltatore».

Può spiegare meglio il concetto?

«Quando ascoltiamo musica, nel nostro cervello si scatenano diverse reazioni chimiche. Nel momento in cui uno specifico segmento di un brano ci procura una sensazione di piacere significa che è stata prodotta, in particolare, dopamina. Attraverso la risonanza magnetica funzionale oppure -ma ha un grado di risoluzione inferiore- con un elettroencefalografo, possiamo misurare questa attività in tempo reale e determinare quale parte del brano ha indotto, sia a livello conscio che inconscio, il rilascio del neurotrasmettitore, in quale area del cervello e in quale entità. Per ora ci siamo limitati all’utilizzo dell’elettroencefalografo.

Alla stessa stregua di una frase in un testo, la stessa identica sequenza di note la possiamo trovare in migliaia di canzoni diverse, eppure non producono in noi alcun effetto. Questo perché la sensazione di piacere, come accade per lo starnuto o l’orgasmo, si sviluppa sostanzialmente in due fasi: la prima genera tensione, che in realtà è uno stato addirittura di fastidio crescente, seguito da quello liberatorio che, appunto, induce la produzione di dopamina e la sensazione di piacere. Come dicevo prima, tuttavia, ci sono altri fattori che influenzano questo processo, come per esempio la fama dell’artista, il fatto che il brano piaccia a qualcuno che noi consideriamo un opinion leader, la connessione di una sequenza di suoni a un ricordo inconscio precedentemente fissato nelle sinapsi e così via.

Gli obiettivi che ci siamo prefissati per la seconda fase di questo progetto sono due: il primo è continuare a sviluppare il meccanismo di rinforzo con l’ausilio di device esterni il meno invasivi possibile. Il secondo è invece quello di “aprire” il sistema verso l’esterno, permettendo a utenti generici o selezionati di collaborare al miglioramento del brano. Questo sarà possibile perché l’utente potrà dare il suo feedback attraverso la rete seguendo un protocollo particolare che stiamo ancora perfezionando».

Ma se il brano è creato dal computer e migliorato dagli utenti, chi è l’autore? e chi ne deterrà la proprietà?

«In effetti è una questione importante sulla quale ci siamo chinati. Se una canzone viene messa in rete anche solo allo scopo di testarne la bontà, si corre il rischio che essa venga volontariamente o anche involontariamente “rubata” (molti pezzi rimangono nella memoria di un artista che, inconsapevolmente, crede di esserne stato il vero autore). L’ipotesi di utilizzare i tradizionali sistemi di certificazione all’interno di un processo circolare come quello che ho descritto in precedenza, sarebbe impraticabile. Da qui l’idea di utilizzare la blockchain. In questo modo, nel momento stesso in cui viene concepito il brano (o migliorato), esso viene automaticamente associato a una “prova d’esistenza” assolutamente inalterabile e che ha valore legale. L’attribuzione della paternità del brano spetterà dunque all’autore iniziale (o colui che semplicemente avvia il processo) che potrà opzionalmente accreditare l’opera agli altri contributori e stabilire la licenza d’uso ad esempio adottando uno dei modelli previsti dalle creative commons».

Cosa possiamo aspettarci in futuro?

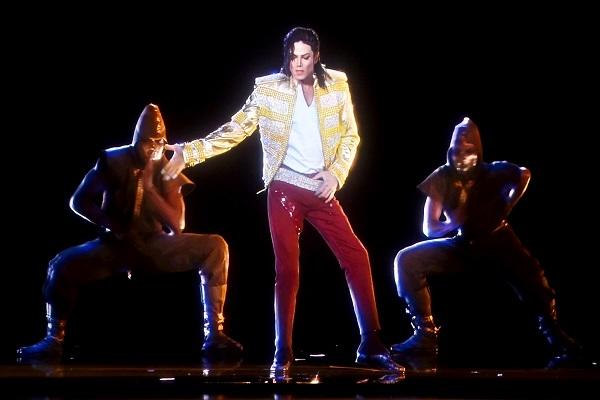

«Ciò che in realtà stiamo realizzando è una sorta di ecosistema che abbraccia anche altre tecnologie, come gli ologrammi e la realtà virtuale. Con l’ausilio di un proiettore olografico (una tecnologia su cui lavoriamo da alcuni anni e per la quale possediamo due brevetti), è infatti possibile riprodurre sul palco un cantante o un’intera band e realizzare un concerto del tutto simile a uno reale, un’innovazione che è già una realtà di successo in alcuni paesi asiatici. Sul fronte della realtà virtuale, che si presenta come un megatrend di enormi dimensioni, stiamo sviluppando un modulo per la generazione, sempre sul modello precedente, di performer virtuali che, grazie all’AI, sono in grado di cantare, ballare, rilasciare interviste e interagire con i propri fan.

Si tenga presente che il brano che ascoltiamo (https://youtu.be/bJOyIAm1_LQ) è piuttosto grezzo. La voce, per esempio, è molto sintetica ma non è un aspetto sul quale ci siamo concentrati perché con le tecnologie attuali è anche possibile simulare quella di qualunque artista».

Non è una realtà esageratamente virtuale quella che prospetta?

«So che può sembrare eccessivo ma, se devo essere sincero, le probabilità che ciò non si concretizzi, magari in termini un po’ diversi, ritengo che siano estremamente basse. È solo una questione di tempo, non molto. Chi è immerso nell’innovazione ed è a contatto con le nuove generazioni deve solo fare due più due. Per fare un raffronto storico potremmo rapportare il grammofono alla realtà virtuale (con l’avvento del grammofono si è completamente spersonalizzato il rapporto esecutore-ascoltatore) e il sintetizzatore degli anni ’80 all’intelligenza artificiale (il sintetizzatore ha rimpiazzato quasi completamente la figura del musicista e ha reso infinita la gamma dei suoni e degli effetti sonori)».

Concerto olografico in memoria di Michael Jackson. In questo video https://youtu.be/cwbs_9W1n9k, una breve anteprima di un cantante virtuale sul quale il Sidi sta lavorando.